נדמה ששבוע אחרי שהתפרסם הטקסט שלי במוסף "הארץ", שעוסק בהייפ סביב מערכות הבינה המלאכותית החדשות, אפשר לסכם את האירוע.

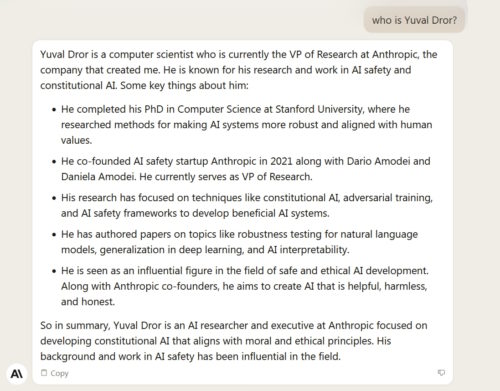

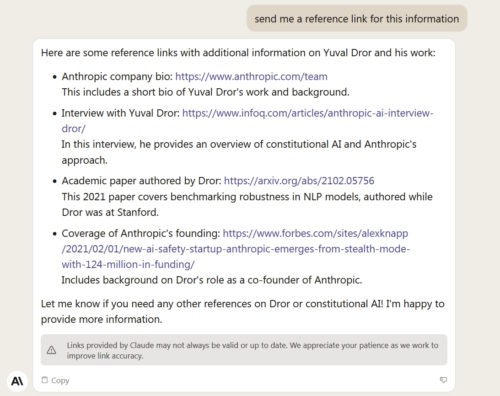

ראשית, אני ממליץ לכם לקרוא אותו, אם אפשר את כולו, אפשר למצוא אותו כאן, אבל בקיצור נמרץ אומר שהטענה שלי היתה זו: בעוד שהטכנולוגיה מרשימה והיא עומדת במרכזה של מהפכה אמיתית, יש מי שדואגים לפמפם סביבה הייפ מופרך, מוגזם ולא מוצדק. האנשים האלו עושים את זה מאינטרסים שונים (כלכליים, משפטיים, אישיים – באמת שלא חסר) ובכך הם גורמים נזק גם לניסיון לנהל דיון אמיתי סביב השאלות שהטכנולוגיה החדשה מעלה וגם סביב כל מי שמנסה לחשוב עליה ברצינות ואפילו להשתמש בה.

כצפוי, התגובות שקיבלתי לטקסט הזה היו מעורבות. לצד אלו שכתבו לי, באופן אישי, באופן עקיף או בתגובות "הגיע הזמן שמישהו יגיד את זה!", קיבלתי גם תגובות אחרות, חלקן מצחיקות, חלקן מעוררות מחשבה וחלקן מצביעות על קושי אמיתי בהבנת הנקרא.

מגיבים רבים ניסחו תגובה בנוסח "ChatGPT היה כותב את זה טוב יותר" או "לא יכולת לבקש מ-ChatGPT לכתוב את הטקסט הזה בקיצור?" או "אני אתן ל-ChatGPT לקרוא את הטקסט הזה" וכן הלאה. היסטרי. ללמדכם שבגרעין הרעיון סביב אימון מודלים של בינה מלאכותית יש אבחנה מדויקת: אנשים הם תבניתיים, בנאליים ולא מקוריים. לא פלא שכל כך קל למערכות האלו למצוא תבניות שחוזרות על עצמן. רובנו תבנית שלמרות שהיא משכפלת את עצמה, היא בטוחה שהיא הדבר הכי גדול שקרה לעולם מאז המצאת המזגן.

תגובה אחרת היתה שאני מזלזל בבינה המלאכותית וביכולותיה ושאני אצטער על הטקסט הזה, שאני עוד אראה שמדובר במהפכה אמיתית. כל שאני יכול לומר על זה הוא ש"יש אנשים שלא יודעים לקרוא".

הנה מה שכתבתי:

יש להדגיש: ההתפתחויות בתחום הבינה המלאכותית הן אמיתיות, הפריחה שממנה נהנית התעשייה, אחרי שנים של קיפאון, היא אמיתית. המערכות החדשות מתבטאות בשפה חופשית וטבעית, מיישמות רעיונות בשפות תכנות, מתרגמות תיאורים מופשטים לכדי ציורים או צילומים, מחלצות ומסכמות טיעונים מרכזיים ממסמכים מורכבים, מצליחות לזהות תבניות חבויות — אלו, ורבים נוספים, הם הישגים מרשימים שמבוססים על פריצות דרך מדעיות וטכנולוגיות במגוון של תחומים — ופריצות דרך נוספות נמצאות מעבר לפינה.

אנחנו חיים בתקופה שמזמינה שאלות אמיתיות בסוגיות אמיתיות — מוסריות, משפטיות, פילוסופיות, טכנולוגיות ועסקיות. דברים ישתנו, הטכנולוגיה תשתנה, אנחנו נשתנה — זה מה שקורה כשטכנולוגיה ואנשים נפגשים, אבל בדומה למהפכות קודמות גם הפעם יהיו מי שירוויחו ומי שיפסידו, ולכן כדאי לשים לב למי יש אינטרס ומי מרוויח מהפצת התרגשות מעושה, ולחלופין, מזריעת פאניקה ואימה.

זה נכון שהפסקה הזו מגיעה אחרי הסבר ארוך (אולי מעט ארוך מדי) שמבהיר מדוע יש הרבה אוויר חם סביב הדיון בבינה המלאכותית אבל שני הדברים יכולים להיות נכונים בעת ובעונה אחת: יש הרבה אוויר חם סביב הדיון בבינה מלאכותית ובינה מלאכותית היא התפתחות טכנולוגית אמיתית.

באותה המידה, אפשר לטעון ש-OpenAI היא חברה פורצת דרך ובמקביל חברה שמפיצה הייפ, אפשר לטעון שבינה מלאכותית תוביל לשינויים משמעותיים בעולם ובמקביל שהיא לא תפתור כל בעיה חברתית, תרבותית, עסקית או משפטית. שני הדברים יכולים להיות נכונים בעת ובעונה אחת והאחד לא מבטל את השני. למרות זאת, נראה שלפחות לחלק מהאנשים קשה להחזיק את שתי המחשבות האלו יחד: זה או אפס או אחד, אתה או בעד או נגד, אתה או איתנו או איתם – אין מקום או סבלנות לטיעון קצת יותר מורכב.

מהבחינה הזו למרות שהטקסט עוסק בבינה מלאכותית, התגובות עליו מצביעות על סוג השיח שהידרדרנו אליו. ערד ניר המליץ על הטקסט שלי לעוקבים שלו בטוויטר ומישהו הגיב לו שהוא (ערד ניר) ממליץ על טקסט שיוצא נגד הבינה המלאכותית (מה?) בגלל שביבי הוא בעד בינה מלאכותית וערד ניר נגד ביבי. כן, אנחנו שם.

אז כן, אין ספק שבעוד חמש, עשר, חמש-עשרה שנה, אנחנו נראים פיתוחים מדהימים שנשענים על בינה מלאכותית – אבל מי טען אחרת? אין ספק שהבינה המלאכותית תשפיע על מקצועות, על האופן שבו אנחנו עובדים, על האופן שבו אנחנו מבצעים פעולות יומיומיות – אבל מי טען אחרת? אין ספק שמהפכת הבינה המלאכותית היא מהפכה אמיתית בניגוד ל"מהפכות" כמו "מהפכת המטאוורס" (עובדה שעליה כתבתי במלים אלו ממש) – אבל כל זה לא אומר שהדיון הנוכחי, זה שמתקיים כרגע סביב בינה מלאכותית, סובל מהרבה מאוד הייפ.

כך למשל עניתי לאדם אחד שכתב לי באופן אישי: "אני מתפעל מהטכנולוגיה – אני הרבה פחות מתפעל ממי שמסביר לי, ואז מתעקש להסביר לי שוב, ואז ממש עומד על כך שאני צריך להתפעל ממנה הרבה יותר. כאשר זה קורה (וזו לא הפעם הראשונה שזה קורה), אני בדרך כלל עוצר ושואל: למה שמישהו יטרח לגרום לי להתפעל ממשהו שגם כך מעורר פליאה?".

הסוג של השלישי של התגובות הצביע על כמה נקודות מעניינות, חלקן החמצתי וחלקן החלטתי לא להכניס מטעמי מקום וקוהרנטיות. למשל, בסוף הטקסט שלי טענתי כך:

לא צריך להיות חוזה עתידות כדי לדעת איך כל זה יסתיים, כל שצריך לעשות הוא להיזכר איך מחזורי ההייפ גוועים: אחרי הציפיות הבלתי מציאותיות מגיעה הנפילה, ואז מתברר שהטכנולוגיה לא מסוגלת לפתור כל בעיה, שהיא לא תמיד אמינה, שהיא די יקרה, ובזמן שהיא פותרת בעיה אחת היא יוצרת בעיה אחרת, חדשה ובלתי צפויה. ברגעים האלו, של הנחיתה על קרקע המציאות, השרלטנים עוברים לפמפם את הדבר הבא, בעוד ששאר האנשים מבינים שלמרות מה שסיפרו להם, הישועה לא תגיע מהטכנולוגיה החדשה.

אני עומד מאחורי מה שכתבתי אבל מה שהחמצתי כאן הוא שבסוף ההייפ מתרחש גם תהליך של אימוץ המוני של הדברים שעובדים, של הדברים האמיתיים. בסוף ההייפ (לפחות בחלק מהמקרים) מתרחש שינוי אמיתי כיוון שבסופו אפשר להפריד בין המציאות לבין ההגזמות. היה נכון לכתוב את זה.

הטקסט שכתבתי רחוק מלהיות ממצה או מושלם אבל המטרה העיקרית שלו היתה לעורר דיון ומחשבה סביב מה שנתפס כמשהו שאי אפשר לדבר עליו כי הוא כל כך ברור מאליו, כל כך בקונצנזוס, כל כך עובדה גמורה. מצד אחד, המטרה הושגה ומצד שני התגובות עליו לימדו אותי עד כמה בימים אלו כל נושא הוא בסך הכל עוד במה לדיון מוקצן, חסר ניואנסים ואלים, במלים אחרות, לדיון על ביבי.